Claude Opus 4.7 偷偷涨价了?497 位开发者实测告诉你真相

你有没有过这种经历?月底收到水电费账单,发现比上个月多了快四成,翻遍通知才发现电价早就调了,只是你没注意。

对很多用 Claude Opus 做开发的工程师来说,这两天就是这种感觉。

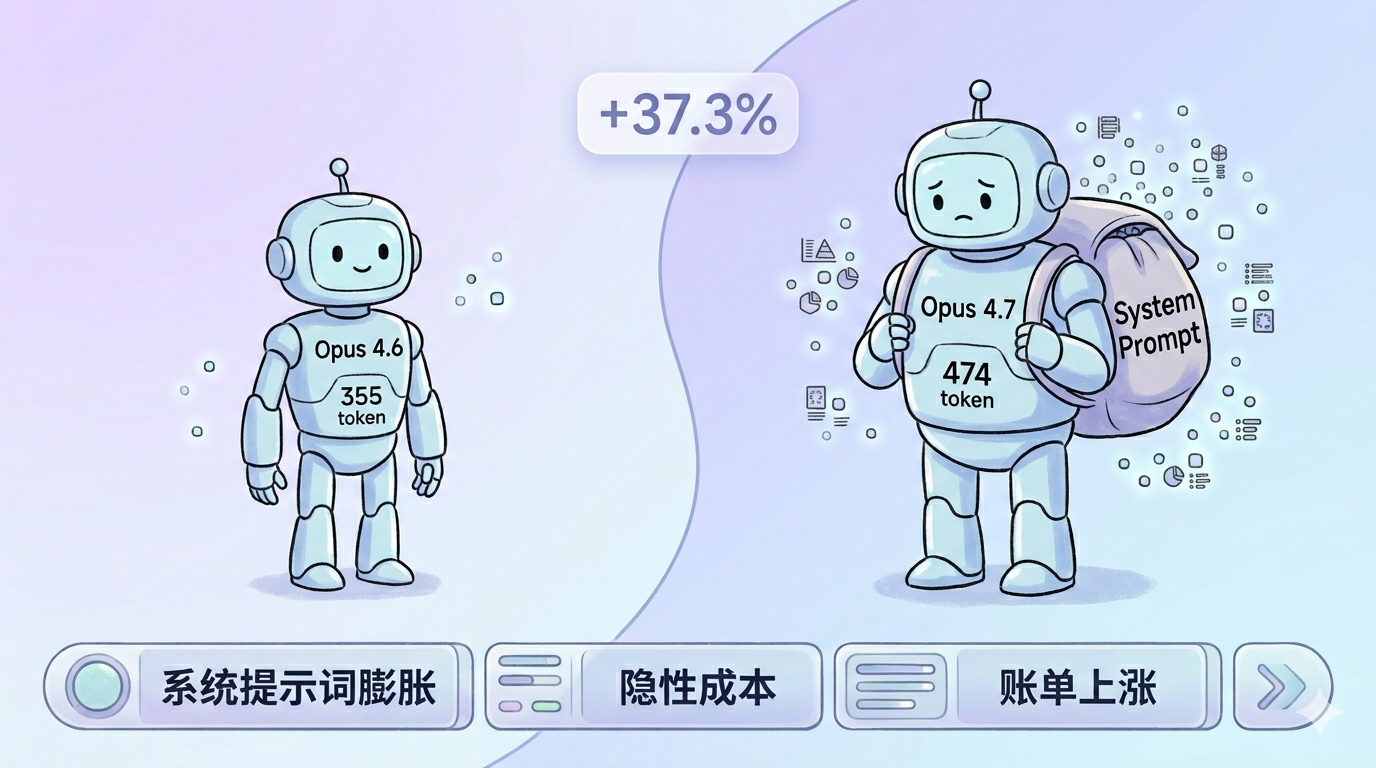

事情的起因是 Hacker News 上一条不起眼的链接。有人做了一个叫 Tokenomics 的网站,专门收集社区里开发者提交的匿名 token 数据。我点进去翻了翻,497 份样本汇总之后,一个数字让人有点懵:Opus 4.7 的平均请求 token 数比 4.6 多了 37.3%。

不是性能提升了 37%,是用量变多了 37%。换句话说,如果你的账单原来是每月一千块,现在可能直逼一千四,而 Anthropic 的 API 定价表上可没写这一笔。

数据不说谎:Claude Opus 4.7 的 token 消耗实测

这个对比网站的设计很聪明。它让开发者把同一套请求分别发给 Opus 4.6 和 4.7,然后匿名上报两边的 token 消耗。没有实验室环境,也没有精心挑选的测试集,全是真实业务场景里实打实的输入。

497 份样本,几乎覆盖了你能想到的各种用法:几百行的代码审查、一段自然语言的需求描述、复杂的系统架构设计 prompt。

汇总结果很一致:

- 平均请求 token 增幅:+37.3%

- 平均成本增幅:+37.3%

- 平均请求大小:从 355 token 涨到 474 token

个别案例更夸张。有人测出来,同一个请求 4.6 只要 8 个 token,4.7 变成了 12 个,涨了 50%。还有人从 28 个涨到 54 个,直接翻倍。当然也有少数没怎么变的,但那只是少数。

为什么 token 会变多?问题可能出在"系统提示词"

如果你只看了数字,可能会以为是 Anthropic 偷偷改了定价。其实不是单价变了,是"用量"变了。

这就好比你去加油站,油价没变,但新车的油耗突然高了。问题不在加油站,在发动机的调校。

同一天晚些时候,Simon Willison 发了篇文章,把这事的原因捅了出来:Opus 4.7 的系统提示词(system prompt)比 4.6 长了将近一半。

系统提示词相当于模型背后的"出厂设置"。它告诉模型该怎么说话、怎么思考、遵守哪些规矩。4.7 的这份"使用说明书"明显厚了不少,里面加了很多关于工具使用、代码执行、安全边界的详细约束。

这些约束本身是对的,确实让模型更靠谱了。但代价是,每次对话开始前,模型都要先"读完"这份更长的说明书。这份说明书占的 token,全算在你的请求头里。

Opus 4.7 的隐性成本:你的项目账单会涨多少?

咱们来算一笔现实的账。

假设你的项目每天发一千次请求给 Opus,平均每次输入加输出一共四千 token。按 Anthropic 当前 Opus 的定价,输入每百万 token 15 美元,输出 75 美元。

在 4.6 时代,如果输入占三分之一、输出占三分之二,你每天的成本大概是:

- 输入:1.33M × 15 = 20 美元

- 输出:2.67M × 75 = 200 美元

- 合计:220 美元/天

换成 4.7 之后,如果输入 token 因为系统提示词膨胀而增加 37%,输出不变,那成本就变成:

- 输入:1.82M × 15 = 27 美元

- 输出:2.67M × 75 = 200 美元

- 合计:227 美元/天

看起来只多了 7 美元?先别急。系统提示词膨胀的不只是你的输入,模型的"思考过程"也可能跟着变长。要是输出也受影响,哪怕只涨 10%,每天就是多 20 美元,一年下来接近八千美元——够雇一个实习生干两个月了。

Claude 账单变贵了怎么办?三个立即可用的节流方案

第一,把你的账单拆细。

别光盯着月度总数。用 Anthropic 控制台或者自己的日志,把输入和输出的 token 拆开看。这样你才知道是"输入暴涨"还是"输出失控",再决定怎么处理。

第二,给请求减肥。

如果确认是系统提示词导致输入膨胀,你可以在自己的应用层做一件事:在发送请求前,精简上下文。不要让模型反复携带几十轮历史对话,该总结的总结,该丢弃的丢弃。

第三,做个 A/B 测试。

如果你的业务对模型版本没那么挑剔,干脆把部分流量切回 4.6,跑一周对比下成本和效果。4.7 在代码能力和推理深度上确实有进步,可如果你的场景只是简单分类或者格式转换,这份增量未必值得买单。

Claude Opus 4.7 升级常见问题

问: Anthropic 官方承认这个问题吗?

Anthropic 到目前为止还没专门回应 token 增长的事。但从系统提示词的公开对比来看,这更像是功能做多了之后的副作用,不是想涨价。

问: 所有用户都会感受到 37% 的增长吗?

不一定。37% 只是个平均值。你要是每次扔几万 token 的代码库过去,系统提示词多那几百个根本感觉不到。但你要是发短消息,那涨幅就扎眼了。

问: Sonnet 和 Haiku 也有这个问题吗?

现在主要有人测的是 Opus。Sonnet 4.7 的系统提示词也变长了,不过没 Opus 这么夸张。Haiku 本来就是走轻量路线的,提示词短,应该影响不大。

写在最后

说实话,模型升级这件事,我们总是习惯性地先看基准测试里的准确率涨了多少个点,很少去注意"吃进去"的 token 也多了几成。497 个人的匿名数据摆在这,提醒的就是一件很简单的事:选模型不能只看能力,还得算成本。有些成本,账单上不会直接写给你看。

你最近有翻过自己的 Claude 账单吗?有没有发现什么异常?评论区聊聊。

顺便分享一个我常用的 AI自媒体运营工具 ,覆盖内容排版、素材处理和效率提效,写公众号会更省力。

最近在玩 Claude Code 的新功能,发现官方出了个 Codex 增强版门户 ,把各种智能编程能力整合在一起了,感兴趣可以去看看。

如果你想看到更多这类工具测评和 AI 编程实战,欢迎关注我的公众号「梦兽编程交个朋友」,每周更新。