让Claude逐步思考,AI就不瞎猜了

让Claude逐步思考,AI就不瞎猜了

你刚睡醒被朋友拽起来,劈头盖脸一堆数学题,让你马上给答案。估计得懵半天吧?

但如果让你先清醒清醒,拿张纸慢慢推演一遍,情况就不一样了。

Claude 也一样。

有时候 Claude 答非所问,或者直接给你个错误答案。不是它不够聪明,是你让它"反应太快"了。

为什么需要让 AI 慢下来

Claude 面对复杂问题时,如果直接要答案,它经常"偷懒"——凭直觉快速判断,而不是认真分析。

考试时老师直接要答案,不让你写过程,你可能蒙对也可能蒙错,但肯定不如认真算一遍靠谱。

关键是:思考必须"出声"才有用。

你不能跟 Claude 说"你自己先想一想,然后把答案告诉我"。它要是只在"脑子里"想,那跟没想一样。必须让它把思考过程写出来,它才真的在思考。

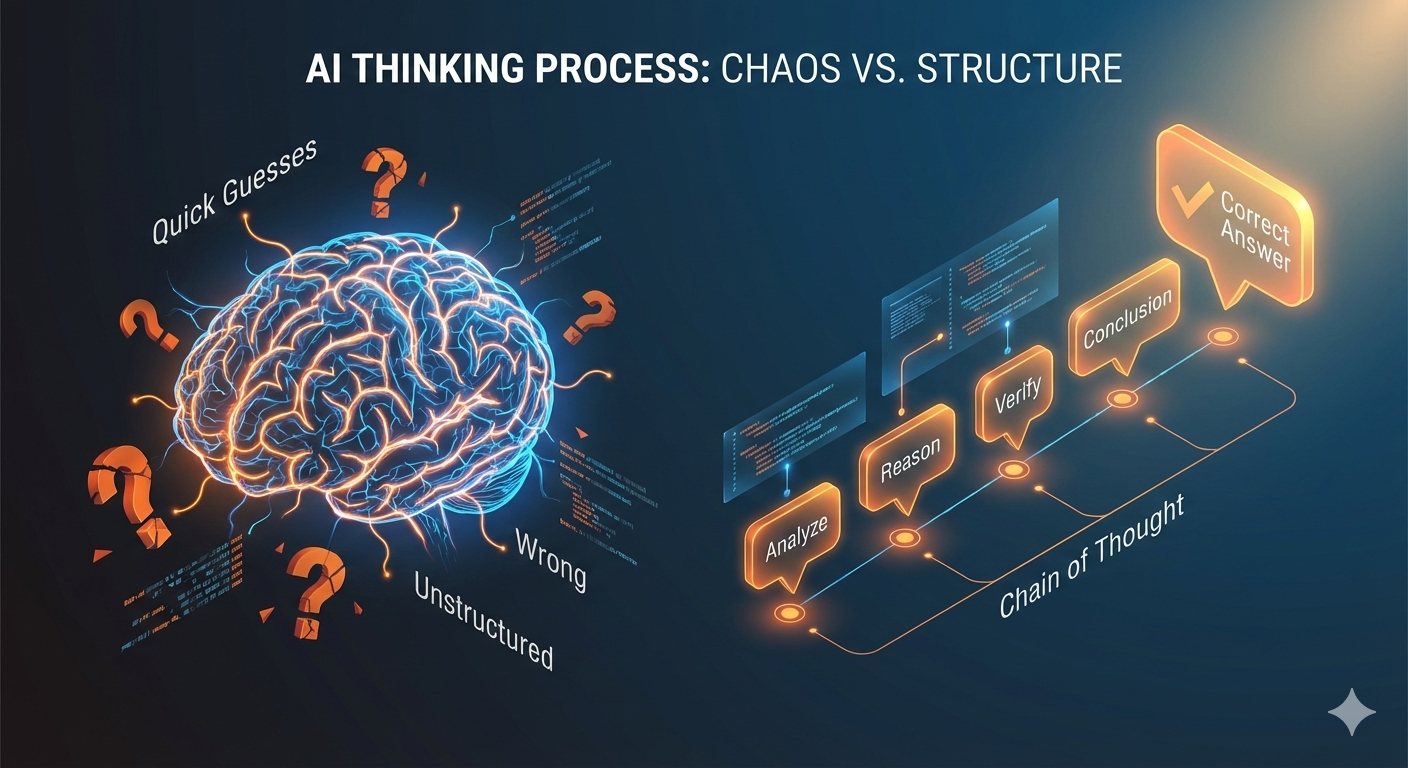

这个技巧在 AI 提示词领域叫"思维链"(Chain of Thought),其实就是让 AI 把推理过程展示出来。

一个真实案例

拿电影评论举个例子:

这部电影让我大开眼界,太新鲜太有创意了。顺便说个完全不��关的事,我从1900年就一直住在一块岩石下面。

你一看就知道这是在讽刺。前面夸电影,后面那句明显是开玩笑说评论者"与世隔绝"。

但直接问 Claude:

这条评论的情感是正面还是负面?

这部电影让我大开眼界,太新鲜太有创意了。顺便说个完全不相关的事,我从1900年就一直住在一块岩石下面。

Claude 可能会抓瞎,因为它看到"不相关"这个词就当真了,认为两部分真的没关系,然后不知道该怎么判断。

让 Claude “出声思考”

换个方式,让 Claude 把思考过程写出来:

这条评论的情感是正面还是负面?请先在 <正面论据> 和 <负面论据> 标签中分别列出支持正面和支持负面的论据,然后给出答案。

这部电影让我大开眼界,太新鲜太有创意了。顺便说个完全不相关的事,我从1900年就一直住在一块岩石下面。

Claude 就会认真分析:

<正面论据>

- 使用了"大开眼界"、"新鲜"、"有创意"等积极词汇

- 表达了对电影创新性的欣赏

</正面论据>

<负面论据>

- 后半段关于"住在岩石下"的内容看似不相关

</负面论据>

答案:正面

让 Claude 把推理过程写出来后,它就能正确识别这是正面评论了。

有个有趣的坑

Claude 有个"怪癖":模棱两可时,它更倾向于选择第二个选项。

把 prompt 改成:

这条评论的情感是负面还是正面?请先在 <负面论据> 和 <正面论据> 标签中分别列出论据,然后给出答案。

“负面"放前面了。这种情况下,Claude 反而可能判断成负面,因为它更"偏爱"第二个选项。

知道之后可以利用,让 Claude 倾向某个答案。但主要还是应该让它真正理解问题,不是玩文字游戏。

实战案例:演员出生年份

问 Claude:

说一部著名电影,主演是1956年出生的演员。

直接问,Claude 可能会瞎猜一个,而且可能是错的。

让它先"头脑风暴"一下:

说一部著名电影,主演是1956年出生的演员。请先在 <brainstorm> 标签中列出一些演员及其出生年份,然后给出答案。

Claude 会:

<brainstorm>

- 汤姆·汉克斯:1956年出生

- 梅尔·吉布森:1956年出生

- 西恩·潘:1960年出生(不对)

</brainstorm>

答案:《荒岛余生》(汤姆·汉克斯主演)

让它先列几个候选人,再从中挑选,准确率立马就上来了。

具体怎么操作

几个要点:

明确要求思考过程

不要直接要答案,而是说:

请先...然后...

先在...标签中列出...再给出答案

首先...其次...最后...

使用 XML 标签组织思考

<brainstorm>...</brainstorm>

<正面论据>...</正面论据>

<负面论据>...</负面论据>

<推理过程>...</推理过程>

给予足够的思考空间

不要让 Claude 偷懒,明确要求它把每一步都想清楚:

请详细分析每个选项的优缺点

请列出至少3个支持你的理由

请逐步推导,不要跳跃

必要时使用角色提示

给 Claude 一个角色身份,能让它思考得更深入:

你是一位经验丰富的影评人...

你是一位细心的数据分析师...

你是一个注重细节的工程师...

这些套路要避开

不要"心算”

自己先想想,然后告诉我答案——不行

请把你的思考过程写在 <思考> 标签中——行

不要省略步骤

直接给我结论——不行

请分三步分析:首先…其次…最后…——行

不要只问一个方向

分析为什么这是正面的——不行

分别列出正面和负面的论据,然后给出结论——行

记住这些

让 AI 出声思考,答案才能靠谱。

遇到复杂问题,先让 Claude"头脑风暴"或"列出论据"。使用 XML 标签组织思考过程。要求 Claude 逐步分析,不要跳跃。模棱两可时,可以调整选项顺序试试。给予明确的角色身份,让思考更深入。

下一步

让 Claude 逐步思考只是 Prompt 工程技巧的一部分。接下来还会聊到:如何用更精准的格式控制输出、如何让 Claude 学会"查漏补缺"、如何处理需要多步推理的复杂任务。

这些 AI 提示词技巧组合起来用,你会发现 Claude 的能力完全不一样。

你有没有遇到过 AI 给你一个明显错误的答案?是什么问题?你是怎么解决的? 欢迎在评论区分享你的经历。

觉得这篇文章有用吗?

- 点赞:如果觉得有帮助,点个赞让更多人看到

- 转发:分享给可能需要的朋友或同事

- 关注:关注梦兽编程,不错过更多实用技术文章

- 留言:有什么问题或想法?欢迎在评论区交流

你的支持是我持续创作的最大动力!